机器之心原创

作者:王子嘉

编辑:Haojin Yang

随着深度学习研究的不断深入,越来越多的领域应用到了深度学习。但是,深度学习取得成功的同时,也不可避免地遭受到越来越多的质疑,特别是在CV领域。本文没有对他人的观点直接做出批判,而是从深度学习的本质出发,探讨它的优势以及相关局限性,最后对深度学习可能的应对方法和未来展开讨论。本文作者为王子嘉,帝国理工学院人工智能硕士在读。1. 深度学习从未停止前进

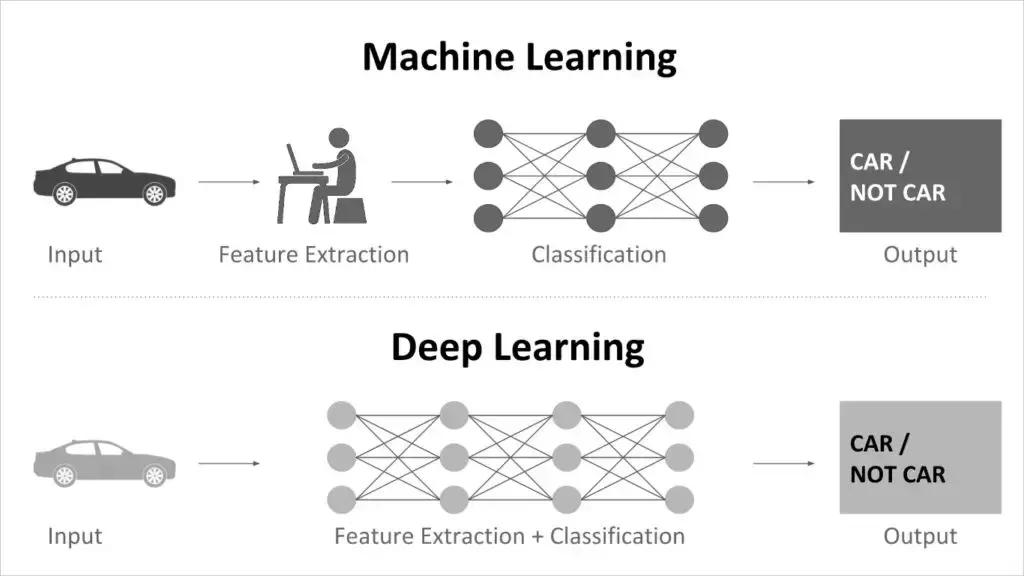

图像数据的特征设计,即特征描述,在过去一直是计算机视觉(Computer Vision, CV)头痛的问题,而深度学习在计算机视觉领域的兴起使得这一领域不再需要很多的人为干预,大大降低了对专业知识的需求(见下图)。对应的,围绕着深度学习开始出现大量的炒作,这样的炒作使得很多人开始对深度学习产生怀疑,但是同样不得忽视的是深度学习在计算机视觉任务上已经获得的大量成功。

(图源://p1-tt.byteimg.com/origin/pgc-image/dd3fd5a2133748d890031cff7fdf73d3.jpg" style="width: 650px;">

(图源:[3])

可以想象,一辆自动驾驶汽车可以行驶数百万英里,但它最终会遇到一些没有经验的新事物;一个机器人可以学会拿起一个瓶子,但如果让他拿起一个杯子,它就得从头学起。

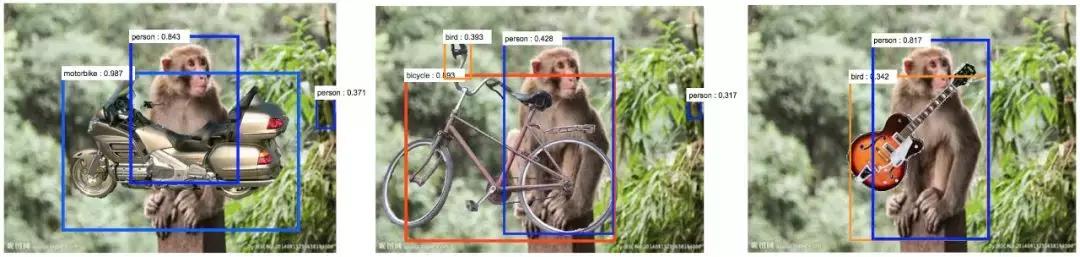

同时,当在图片中掺杂一些人类不可见的噪音,或是对背景进行一些改变,都可能会让模型的预测出错。下图就是一个改变背景的例子,从下图可以看出,当背景物品从自行车变为吉他之后,这只猴子被预测成了一个人,这大概是因为模型在训练的时候认为人比猴子要更可能有一把吉他。

(图源://p1-tt.byteimg.com/origin/pgc-image/e2ac844d1a8a4bd9ae274554ea21441d.jpg" style="width: 650px;">

(图源://p1-tt.byteimg.com/origin/pgc-image/cf670fb4d712474eb442b7c471ac8abe.jpg" style="width: 650px;">

(图源自论文)

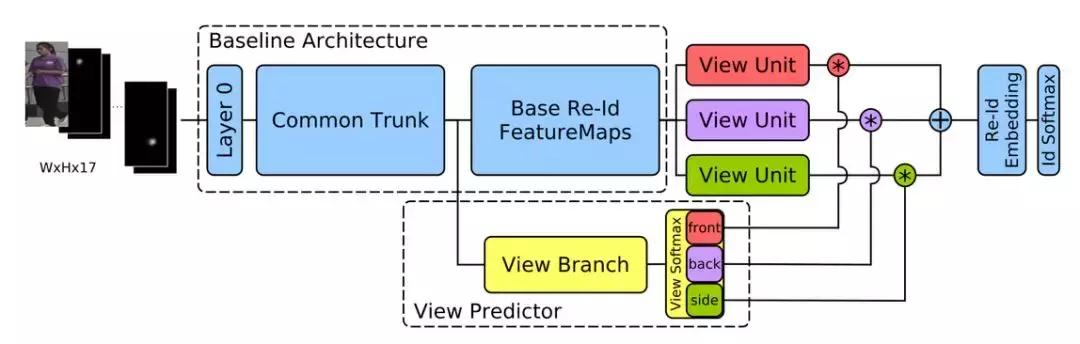

[12] 提出了一种行人重识别(person re-identification)的新方法,这个问题一般是通过基于检索的方法来解决的,即求导查询图像与来自某个嵌入空间的存储图像之间的相似度度量,而本文中的框架将姿势信息直接嵌入到 CNN 中,并设计了一个新的无监督重排序方法。完整的框架如下图所示,其中 Baseline Architecture 使用的是 ResNet-50,同时一个简单的 View Predictor 与 Baseline Architecture 一起提供了姿态信息作为后面的输入。

(图源自论文)

域适应(Domain Adaptation)

严格来说,域适应应该也算迁移学习的一种,不过上文提到的迁移学习主要说的是样本迁移。域适应的目的其实跟数据合成类似,都是为了得到更多的有标注数据。简单来说,就是用任务 A 的数据来为任务 B 准备数据,或者说是将这个数据改造成适合任务 B 的数据。

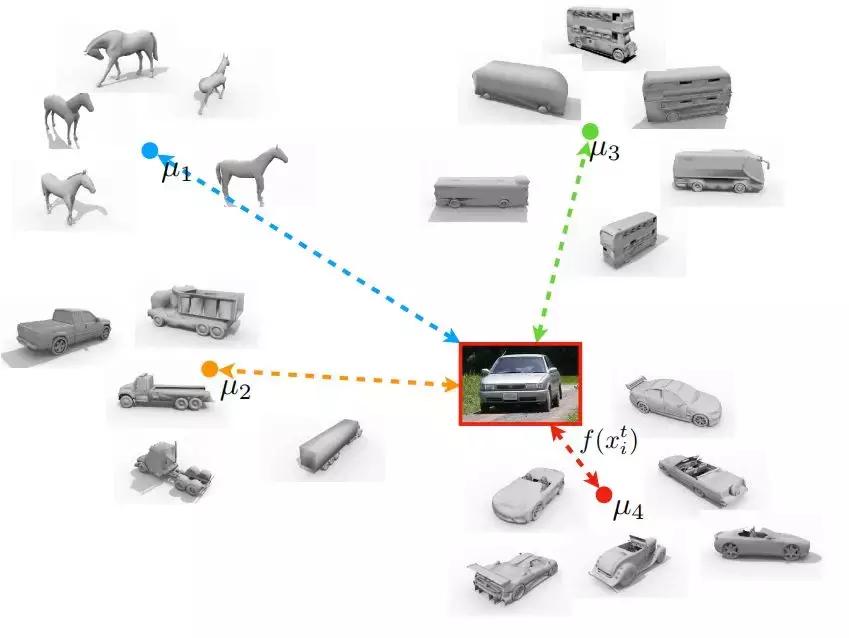

举一个例子,利用相似性学习的无监督域适应 [1] 使用对抗性网络来处理域适应。作者使用一个网络从有标记源中提取特征,又利用另一个网络从未标记的目标域中提取特征,这些特征的数据分布相似但不同。为了标记来自目标域的图像,作者将图像的嵌入与来自源域的原型图像的嵌入进行比较,然后将最近邻居的标签分配给它。另一个域适应的例子是 [15],文中提出了一种图像到图像的转换,主要用了 3 种主要技术:(i)domain-agnostic feature extraction(无法区分领域的特征的提取),(ii)domain-specific reconstruction(嵌入可以被解码回源域和目标域),和(iii)cycle consistency(正确学习映射)。从根本上来说,这个方法的目的就是找到从源数据分布到目标数据分布的映射结构。

除了上面的例子,最近 [10] 也提出了一种利用 Bayesian 来做域适应的方法。

(图源:[1])

4. 总结

由本文可见,当下深度学习有自己的优势,也有一定的局限性,而深度学习专家们也在尽力解决这些局限性。对于深度学习的未来,我相信除了它自己的改进外,它也会在一些新兴领域如 NLP 与 CV 结合的产物——Visual Question Answering(VQA)中大放异彩。当然,未来也很有可能会出现更加智能的模型来代替现在的深度学习模型。

References

[1] Pedro Oliveira Pinheiro. Unsupervised domain adaptation with similarity learning. CoRR, abs/1711.08995, 2017.

[2] Matiur Rahman Minar and Jibon Naher. Recent advances in deep learning: An overview. CoRR, abs/1807.08169, 2018. [3] Alan L. Yuille and Chenxi Liu. Deep nets: What have they ever done for vision? CoRR, abs/1805.04025, 2018.

[4] Charles Ruizhongtai Qi, Li Yi, Hao Su, and Leonidas J. Guibas. Pointnet++: Deep hierarchical feature learning on point sets in a metric space. CoRR, abs/1706.02413, 2017.

[5] Aleksandar Zlateski, Ronnachai Jaroensri, Prafull Sharma, and Fr´edo Durand. On the importance of label quality for semantic segmentation. In The IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 2018.

[6] Artidoro Pagnoni, Stefan Gramatovici, and Samuel Liu. PAC learning guarantees under covariate shift. CoRR, abs/1812.06393, 2018.

[7] Mingfei Sun and Xiaojuan Ma. Adversarial imitation learning from incomplete demonstrations. CoRR, abs/1905.12310, 2019.

[8] Y. Tamaazousti, H. Le Borgne, C. Hudelot, M. E. A. Seddik, and M. Tamaazousti. Learning more universal representations for transferlearning. IEEE Transactions on Pattern Analysis and Machine Intelligence, pages 1–1, 2019.

[9] Zhongzheng Ren and Yong Jae Lee. Cross-domain self-supervised multitask feature learning using synthetic imagery. CoRR, abs/1711.09082, 2017.

[10] Jun Wen, Nenggan Zheng, Junsong Yuan, Zhefeng Gong, and Changyou Chen. Bayesian uncertainty matching for unsupervised domain adaptation. CoRR, abs/1906.09693, 2019.

[11] Rohit Girdhar, Georgia Gkioxari, Lorenzo Torresani, Manohar Paluri, and Du Tran. Detect-and-track: Efficient pose estimation in videos. CoRR, abs/1712.09184, 2017.

[12] M. Saquib Sarfraz, Arne Schumann, Andreas Eberle, and Rainer Stiefelhagen. A pose-sensitive embedding for person re-identification with expanded cross neighborhood re-ranking. CoRR, abs/1711.10378, 2017.

[13] Jonathan Tremblay, Aayush Prakash, David Acuna, Mark Brophy, Varun Jampani, Cem Anil, Thang To, Eric Cameracci, Shaad Boochoon, and Stan Birchfield. Training deep networks with synthetic data: Bridging the reality gap by domain randomization. CoRR, abs/1804.06516, 2018.

[14] Honglun Zhang, , Wenqing Chen, Hao He, and Yaohui Jin. Disentangled makeup transfer with generative adversarial network. CoRR, abs/1804.06516, 2019.

[15] Zak Murez, Soheil Kolouri, David J. Kriegman, Ravi Ramamoorthi, and Kyungnam Kim. Image to image translation for domain adaptation. CoRR, abs/1712.00479, 2017.

版权声明:CosMeDna所有作品(图文、音视频)均由用户自行上传分享,仅供网友学习交流。若您的权利被侵害,请联系删除!

本文链接://www.cosmedna.com/article/428973567.html